Report des règles “haut risque” de l’UE de l’AI Act : Décryptage et Analyse

L’UE vient d’annoncer qu’elle repousse d’un an l’application des règles les plus strictes de l’AI Act concernant les systèmes « haut risque », désormais attendues en décembre 2027. Ce report n’est pas un simple ajustement de calendrier.

Il reflète un bras de fer direct entre régulateurs européens et géants technologiques.

Les entreprises ont exprimé leur crainte de coûts trop élevés, délais trop courts et manque de clarté technique. L’UE, de son côté, tente d’éviter un frein à l’innovation tout en posant des garanties solides pour les citoyens.

Qu’est-ce que l’AI Act ?

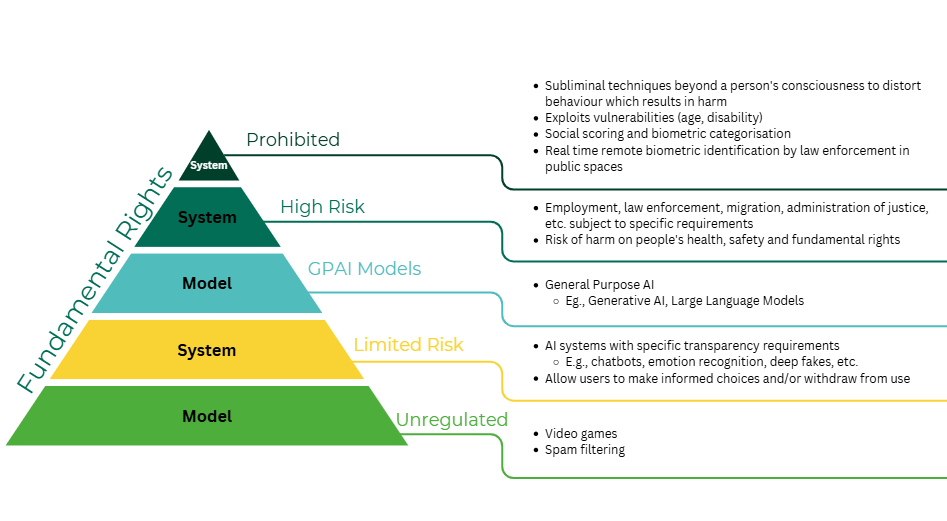

L’Artificial Intelligence Act (AI Act) est le premier règlement complet au monde consacré à l’encadrement de l’Intelligence Artificielle. Adopté par l’Union européenne, il vise à garantir un usage sûr, transparent et responsable de l’IA, tout en préservant l’innovation.

Il est entré en vigueur le 1 août 2024. Avec une approche fondée sur les risques : selon le niveau de risque que représente un système d’IA, des obligations plus ou moins fortes s’appliquent. L’Ai Act régit non seulement les acteurs européens mais aussi, dans certains cas, les acteurs hors UE dont les systèmes d’IA sont “utilisés sur le marché européen”.

Comment l’AI Act est-il structuré ?

On peut le décomposer en plusieurs blocs clés

Classification par niveau de risque

| Catégorie | Exemple typique | Niveau d’obligation |

|---|---|---|

| Unacceptable risk (risque inacceptable) | Systèmes de social scoring publics ou reconnaissance biométrique en temps réel sans contrôle adéquat | Interdits |

| High-risk (haut risque) | IA utilisée dans les infrastructures critiques, santé, recrutement, justice, sécurité | Obligations strictes (qualité des données, transparence, documentation, audits…) |

| Limited risk (risque limité) | Chatbots, génération de contenu, systèmes manipulant l’information | Transparence obligatoire (ex : dire à l’utilisateur qu’il s’adresse à une IA) |

| Minimal risk (risque minimal) | Filtres anti-spam, jeux vidéo IA simple | Pas de nouvelle obligation spécifique (ou très légère) |

Les grandes obligations de l’AI Act

Le règlement impose un ensemble d’exigences selon le niveau de risque :

- Contrôle de la qualité des données (biais, représentativité)

- Documentation technique complète

- Traçabilité des processus

- Évaluation de sécurité

- Transparence envers les utilisateurs

- Possibilité d’audit par les autorités

- Mise en place d’un “contrôle humain” lorsque nécessaire

- Gestion des incidents, suivi en continu

Les modèles d’IA dits “à usage général” (GPAI), comme les grands modèles génératifs, sont également encadrés. Ils doivent fournir :

- une documentation détaillée,

- des évaluations de risques,

- des informations sur les données utilisées pour l’entraînement.

Un report important : application décalée à décembre 2027

L’une des informations les plus marquantes récentes concerne le report d’un an des obligations applicables aux IA “haut risque”.

La Commission européenne a proposé de repousser l’échéance à décembre 2027, en raison :

- de la complexité technique du déploiement,

- des difficultés de mise en conformité,

- et surtout des pressions exercées par plusieurs grands acteurs technologiques.

Ce report vise à éviter une mise en œuvre trop rapide qui pourrait pénaliser l’innovation et à laisser aux entreprises le temps de s’adapter.

Effets attendus sur les géants de la tech

a) Conformité obligatoire, même hors UE

L’AI Act a une portée extraterritoriale.

Une entreprise américaine, asiatique ou autre doit s’y conformer dès lors que son IA est utilisée dans l’UE.

C’est un changement majeur qui force les géants mondiaux à aligner leurs pratiques.

b) Coûts et réorganisations internes

Les grandes entreprises devront :

- réviser la conception de leurs modèles,

- documenter précisément leurs systèmes,

- renforcer leurs contrôles internes,

- garantir une supervision humaine,

- gérer les risques de biais et de sécurité.

Ces obligations représentent des coûts importants, notamment pour les modèles de grande taille.

c) Réduction potentielle d’avantages compétitifs

L’obligation de transparence pourrait mettre en lumière :

- les biais internes,

- les limites techniques,

- les méthodologies d’entraînement,

des éléments jusque-là stratégiques.

Certains acteurs craignent une perte d’avantage face à des concurrents opérant dans des zones moins réglementées.

d) Normalisation globale probable

Comme pour le RGPD, l’AI Act pourrait devenir la référence mondiale.

De nombreux pays envisagent déjà :

- d’harmoniser leurs lois avec le modèle européen,

- ou d’adopter un cadre similaire.

Les géants de la tech anticipent donc une internationalisation de ces exigences.

e) Pressions, critiques et débats

Plusieurs grandes entreprises européennes ont exprimé leurs inquiétudes, estimant que :

- les obligations sont lourdes,

- les délais sont trop courts,

- et que l’Europe risque de ralentir son avancée dans l’IA.

Le report de 2026 à 2027 montre que la Commission reconnaît la complexité du sujet.

Quelques points de vigilance / évolutions à surveiller

- La finalisation des standards techniques (normalisation via CEN/CENELEC ou autres) : ils détermineront comment les obligations s’appliquent concrètement.

- L’application effective des sanctions et la capacité des autorités nationales à faire respecter le cadre.

- L’évolution rapide des technologies IA : les modèles génératifs, fondation models, deep-fakes, etc., posent des défis nouveaux que l’Acte devra encadrer.

- L’équilibre entre “contrôle” et “innovation” : si les coûts sont trop élevés, le risque est de créer un retard européen ou de voir des acteurs se détourner.

- La portée extraterritoriale et la réaction des acteurs mondiaux : comment les entreprises américaines, chinoises ou autres s’adapteront-elles ?

En résumé

Le AI Act est un jalon majeur : c’est le premier règlement global ambitieux sur l’IA, instaurant un cadre clair de ce qui est permis, restreint ou interdit en Europe. Il pose un standard de gouvernance, de transparence, de qualité et de responsabilité.

Pour les géants de la tech, c’est un tournant : ils encourent d’importants coûts de conformité, doivent ajuster leurs modèles commerciaux, et savent que leur fonctionnement global est sous surveillance accrue.

Pour l’écosystème technologique mondial, c’est un signal : l’ère “Wild West” de l’IA semble se terminer, place à la “IA de confiance”.

Iwincash… that sounds like exactly what I’m after! Hope the cash-out process is smooth. Always a pain when it’s not. Anyone had any luck here? See for yourself on iwincash!

https://www.okebet3u.org I am thanksful for this post!

https://www.philbetts.net I am thanksful for this post!

9apisologin https://www.it9apisologin.com

bk8casino https://www.bk8casinovs.com

jilivip https://www.jilivipu.net

tayawin https://www.tayawinch.net

jililuck 22 https://www.jililuck-22.com

taya777login https://www.wtaya777login.com

pin77 online https://www.pin77-online.com

pagcor https://www.ngpagcor.net

okebet168 https://www.okebet168u.org

playpal77 https://www.playpal77sy.org